人工智能技术的高速发展为社会各领域带来深刻变革,但AI 滥用问题也随之凸显 —— 在身份认证领域,以DeepFakes为核心的伪造技术(如 AI 换脸),被不法分子用于制作虚假音视频、冒充他人身份实施诈骗,不仅严重扰乱网络秩序,更对公民隐私安全、财产安全构成直接威胁。

当前,活体检测技术已广泛应用于身份验证、金融交易等关键场景,成为保障安全的重要屏障。然而,黑灰产的虚拟视频注入攻击正持续升级:攻击手段从早期的静态照片伪造,逐步向动态视频合成演进,甚至能通过 DeepFakes 模拟真人自然表情与语音同步,绕过传统检测机制。这类攻击手法其专业性、隐蔽性与复杂性远超传统犯罪,已引发社会各界高度关注,也对活体检测厂商的安全防护能力提出持续升级的要求。

历数国内AI诈骗案件

作为人脸身份认证领域的解决方案专家,深圳市易顺达科技有限公司持续关注着人工智能技术的负向应用问题。

根据境内多地警方公布信息和权威媒体报道,对近年AI诈骗案件进行了整理汇总:

| 时间 | 案件详情 |

|---|---|

| 2025年9月 | 深圳某企业会计遭遇伪造领导视频指令,诈骗分子使用深度伪造技术生成4k分辨率伪造视频,实施诈骗 |

| 2025年8月 | 北京反诈中心通过数字水印逆向备课,破获2000万元的AI换脸诈骗团伙 |

| 2025年7月 | 赵某夫妇因不具备贷款资格,找到"贷款中介"邱某,邱某利用AI换脸技术伪造了赵某夫妇的任职收入证明,搭配假公章骗取了银行25万元贷款 |

| 2025年5月 | 深圳某公司遭遇AI换脸冒充董事长视频会议诈骗,损失98万元 |

| 2024年12月 | 杭州退休教师被伪造孙子车祸急救场景诈骗,三小时内转账28万元 |

| 2024年6月 | 广西某市民接到女儿哭啼车祸AI拟声电话,被转账15万元至虚假医院账户 |

| 2024年 | 中国香港的一名职员在一场多人"视频会议"中被骗2亿港元,后来才发现除了自己之外,其他与会者均为AI换脸生成的虚假形象 |

| 2024年 | 深圳发生一起利用AI语音克隆技术的精准诈骗案件,犯罪分子冒充某科技公司CFO,以紧急支付供应商货款为由,骗得公司财务人员转账198万元 |

| 2023年11月 | 江苏省苏州市相城区的居民刘一宁遭遇"AI配音"诈骗,"绑匪"用克隆的刘一宁女儿的声音,谎称其女儿在英国留学时遭遇绑架,威胁她拿出60万赎金 |

| 2023年5月 | 福州某科技公司法人代表郭先生接到好友AI换脸的视频电话,称急需430万保证金用于竞标,并伪造转账记录截图,郭先生未核实便转账,事后发现好友账号被盗 |

| 2023年 | 英国某大型跨国公司遭遇利用深度伪造技术的定向诈骗,"高管"指示财务人员向所谓"合作方"紧急转账,导致单笔损失高达240万美元 |

| 2023年 | 日本犯罪团伙利用开源工具生成含恶意二维码的"限时优惠"虚假海报,诱导用户扫码,3小时即盗取价值350万美元的加密货币 |

| 2023年 | 武汉杨女士QQ收到称"女儿同学"发来的语音,说手机没电,急需3.5万元缴纳培训报名费,杨女士听到音色确认是女儿,立刻回款,后知被骗 |

| 2022年2月 | 浙江温州的陈先生被"好友"诈骗了近5万元,诈骗分子利用陈先生好友在社交平台发布的视频,截取其面部视频画面后再利用"AI换脸"技术合成,制造陈先生与"好友"视频聊天的假象骗取其信任,从而实施诈骗 |

| 2020年 | 数字加密货币交易所OKX遭到一个AI诈骗团伙有组织的攻击,该团伙通过Deepfake AI,绕过了该交易所对用户的人脸识别安全措施,在25分钟内从数个账户中转走了价值1100万美元的数字加密货币 |

| 2020年 | 有不法分子利用AI换脸生成某公司领导面孔,要求该公司高管转账,致使该高管被诈骗150万元 |

面向DeepFakes攻击,用AI打败AI

如何做好攻击技术手段剖析、检测手段升级已成为网络安全领域的紧迫任务。回顾攻击演进历史,人脸攻击已经从早期的物理介质攻击(照片、视频等)迭代到数字合成攻击(人脸替换、属性编辑、表情驱动等),黑产技术日臻成熟,手段也更加隐秘。

阶段一:静态照片攻击 vs 动作活体检测(2010-2017年)

| 维度 | 具体内容 |

|---|---|

| 攻击核心手法 | 窃取用户静态照片(社交平台、证件照),直接用照片/打印件尝试人脸识别。 |

| 防御升级方向 | 1. 引入动作活体检测:要求用户完成眨眼、张嘴、摇头等随机动态动作;2. 验证逻辑:通过追踪人脸关键点(如眼睑闭合轨迹),判断是否为"动态真人"。 |

| 关键对抗结果 | 照片攻击基本失效,但催生了"动态视频翻拍"的新攻击思路。 |

| 典型案例 | 2019年某银行拦截伪造身份证照片开户案,通过"张嘴+摇头"动作检测识别异常。 |

阶段二:视频翻拍攻击 vs 静默活体检测(2017-2020年)

| 维度 | 具体内容 |

|---|---|

| 攻击核心手法 | 用手机/平板播放用户动态视频(如社交平台日常视频),通过"翻拍屏幕"模拟活体动作,绕过单一动作检测。 |

| 防御升级方向 | 1. 新增静默活体检测:识别"摩尔纹"(屏幕刷新率与摄像头采样率冲突产生的条纹),判断是否为翻拍;分析光线反射差异(真实皮肤漫反射vs屏幕镜面反射);2. 优化动作检测:随机生成动作指令(如"向左转头"),增加预录视频的破解难度。 |

| 关键对抗结果 | 普通视频翻拍被遏制,但攻击者开始用"高清屏幕+偏振镜"消除摩尔纹,突破静默检测。 |

| 典型案例 | 2018年支付宝通过摩尔纹检测,拦截多起"播放他人支付视频"的盗刷攻击。 |

阶段三:硬件优化攻击 vs 炫彩/3D活体检测(2020-2022年)

| 维度 | 具体内容 |

|---|---|

| 攻击核心手法 | 1. 用4K高清屏幕减少摩尔纹,搭配偏振镜过滤反光;2. 用视频编辑工具(如AE)伪造自然动作,甚至用早期AI换脸(FaceSwap)生成动态人脸。 |

| 防御升级方向 | 1. 推出炫彩活体检测:设备发射红/绿/蓝多光谱光,分析皮肤对不同波长光的吸收/反射特性(真实皮肤有皮下血管特征,屏幕无);2. 引入3D结构光技术:投射激光点阵重建人脸三维模型,识别硅胶面具、屏幕翻拍的平面特性。 |

| 关键对抗结果 | 硬件优化攻击成功率下降,但AI换脸技术的成熟(如GANs模型)带来新威胁。 |

| 典型案例 | 2021年某金融机构用3D结构光,拦截高精度硅胶面具伪造的信用卡开卡申请。 |

阶段四:AI深度伪造攻击 vs 多模态智能检测(2022年至今)

| 维度 | 具体内容 |

|---|---|

| 攻击核心手法 | 1. AI换脸技术成熟:用GANs/扩散模型生成高保真人脸,实现"表情迁移+语音同步"(如2024年香港2亿港元诈骗案的"多人AI换脸会议");2. 端到端自动化:多模态大模型(如Sora)支持"文本输入→视频输出",几分钟生成逼真诈骗素材;3. 产业化:暗网提供"AI换脸+伪造证件"的"身份包",降低攻击门槛。 |

| 防御升级方向 | DeepFakes专项检测:分析微表情(如眼周肌肉颤动)、音画同步性(AI换脸常出现口型与语音错位);用AI模型定位视频篡改区域(如光影矛盾、边缘模糊);多模态融合防御:结合"人脸检测+语音验证+行为风控"(如分析用户历史转账习惯,识别异常操作);强制高风险操作二次验证(如指纹、人工复核)。创新的炫彩活体检测:基于屏幕随机颜色打光,通过面部反光 + 瞳孔反光的表现进行活体检测判断,能够更有效拦截视频、图片伪造、3D 面具、合成图等攻击手段。设备环境感知:识别摄像头环境、光线反射、屏幕边框等异常特征;黑产情报联动:实时共享攻击脚本、素材库、异常特征等情报,建立"图谱式风控网"。 |

| 关键对抗结果 | 防御进入"AI对AI"阶段,检测精度依赖模型训练数据与实时迭代速度。 |

| 典型案例 | 易顺达推出"端云结合方案",基于海量攻击样本,不断迭代进化,为高安全性、高通过率、高识别率的身份核验流程保驾护航。 |

面对这一严峻挑战,易顺达【端云结合】人脸核身系列产品重磅上线。新客户可获得100次免费活体检测资源包。

我们依托多年 AI 算法研发经验,以 "主动防御、持续进化" 为核心,推出具备自主知识产权的深度伪造检测技术,为打击 AI 滥用提供强有力的技术支撑。该技术系统采用端云结合模式,构建多维度防护体系:

- 核心技术融合:综合运用风控决策引擎、创新炫彩活体检测、多模态智能识别三大核心能力,可有效防御新型DeepFakes攻击手法;

- 鲁棒性保障:基于海量真实样本训练与特征对抗学习机制,系统能敏锐捕捉DeepFakes 漏洞,具备应对新型伪造技术的持续进化能力

根据线上真实数据反馈,相比传统的活体检测模式,端云结合的"主动防御、持续进化"方案,整体的防御效果更好,能够有效验证用户是否存在欺诈或作弊行为,可为金融、政企、交通出行等业务办理提供更高的安全保障。

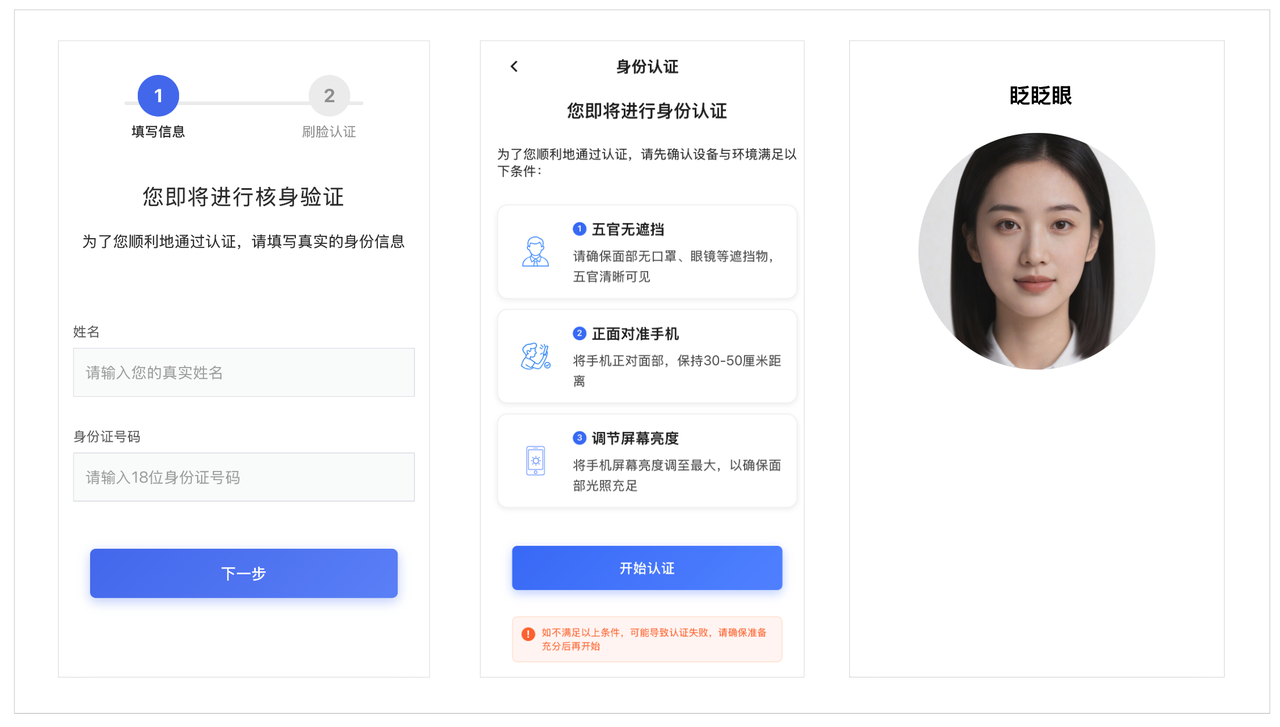

在产品服务上,易顺达围绕人脸身份核验场景,形成了实人认证、活体检测、人脸1:1认证、人脸1:N认证等丰富的人脸核身AI安全产品矩阵,实现微信小程序、公众号、APP、H5、智能终端等场景的全面覆盖。

扫描小程序码可进入「eShunda小程序」免费体验